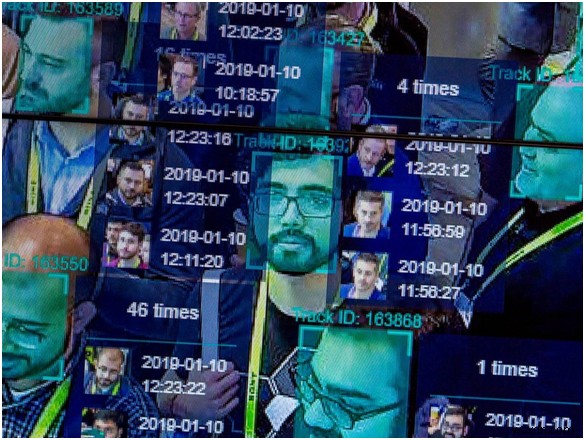

चेहरे की पहचान प्रौद्योगिकी और इसकी क्षमताएं हमारी कल्पना से कहीं आगे बढ़ गई हैं जब से कानून प्रवर्तन में इस तकनीक को सुदृढ़ करने के लिए नए एल्गोरिदम प्रमुखता में आए हैं। वर्तमान में, चेहरे की पहचान तकनीक का उपयोग कानून प्रवर्तन बलों द्वारा भीड़-भाड़ वाली सभाओं के बीच आपराधिक अपराधियों की पहचान करने के लिए डेटा एकत्र करने की प्रक्रियाओं के निम्नतम स्तरों पर किया जाता है। तकनीक सार्वजनिक स्थानों और सड़कों पर सीसीटीवी कैमरों से फुटेज का उपयोग करती है और फिर आपराधिक अपराधों के लिए वांछित चेहरे का पता लगाने के लिए एजेंसी अभिलेखागार के विरुद्ध एकत्रित डेटा चलाती है।

इस तकनीक को मोबाइल फोन और स्मार्ट पहनने योग्य उपकरणों सहित सबसे छोटे गैजेट्स में एम्बेड किया गया है। इसलिए, यह न केवल सड़कों पर आपकी सुरक्षा कर रहा है बल्कि आपके स्मार्ट उपकरणों पर संग्रहीत आपकी व्यक्तिगत जानकारी की रक्षा करने का भी इरादा रखता है। सोशल मीडिया अभियान के आधुनिक युग में विपणन और विज्ञापन प्रथाओं के लिए "फेसप्रिंट" का उपयोग करना आम हो गया है। और फिर, मॉल, रिटेल स्टोर आदि में निजी निगरानी होती है।

इस दृष्टिकोण से, चेहरे की पहचान तकनीक के निर्विवाद लाभों को जल्दी से इंगित किया जा सकता है। लेकिन उपयोगकर्ता की गोपनीयता, डेटा सुरक्षा, और निश्चित रूप से, कानून और जनता के बीच पारदर्शिता के लिए होने वाले खतरे के लिए भी इसकी छानबीन की गई है। इस तरह की आक्रामक तकनीक के फायदे और कमियां दोनों के बारे में पता होना अच्छी बात है। फिर भी, फेस रिकग्निशन तकनीक का एक और नुकसान है, जिसे लोग नज़रअंदाज़ करते हैं, और वह है नस्लीय रूपरेखा और नस्लीय भेदभाव ।

इस लेख में, हम देखते हैं कि यह तकनीक कैसे नस्लीय पूर्वाग्रह और भेदभाव को बढ़ावा देती है और इस तरह की आक्रामक तकनीक के नतीजे कितने गंभीर हैं।

चेहरे की पहचान कैसे काम करती है?

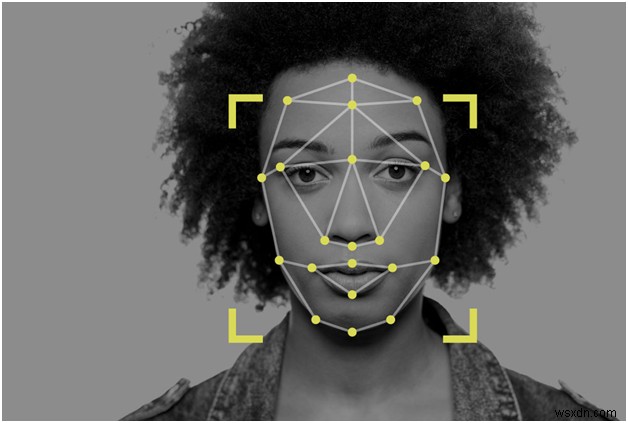

चरण 1: आपकी एक तस्वीर एक कैमरे, आपके खाते, ईमेल आदि से ली गई है। यह या तो एक सीधी प्रोफ़ाइल तस्वीर है या भीड़ में एक यादृच्छिक तस्वीर है।

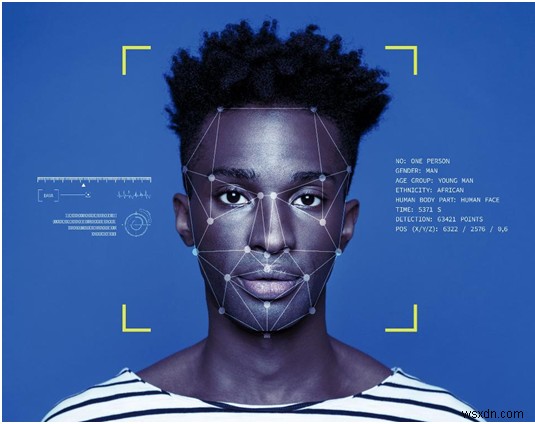

चरण 2: फेस रिकग्निशन सॉफ्टवेयर आपके चेहरे को संग्रहीत फेसप्रिंट के डेटाबेस के माध्यम से चलाएगा। फेसप्रिंट आपके चेहरे की ज्यामितीय ट्रैकिंग के माध्यम से इकट्ठा किया जाता है।

चरण 3: किसी भी ज्ञात फ़ेसप्रिंट के विरुद्ध आपकी तस्वीर का मिलान प्रतिशत एल्गोरिद्म का उपयोग करके तैयार किया जाता है, जिस पर एक निर्धारण किया जाता है।

ऑटोमेशन बायस:फेशियल रिकॉग्निशन टेक की कई खामियों में से एक

ऑटोमेशन बायस या मशीन बायस उस परिदृश्य को संदर्भित करता है जहां एक मशीन एल्गोरिथ्म इनपुट डेटा के अंशांकन में एक निश्चित पूर्वाग्रह प्रदर्शित करता है, इस प्रकार प्रतिकूल आउटपुट देता है। यह तब होता है जब एल्गोरिथम कोड में कोई त्रुटि होती है, अंशांकन के लिए संग्रहीत डेटा-सेट की कमी, गलत इनपुट मान, या अत्यधिक इनपुट डेटा, जो मशीनों की जांच करने की क्षमता से परे है।

नस्लीय प्रोफाइलिंग इन सबके साथ कैसे चलती है?

आइए एक प्राचीन घटना से शुरू करते हैं जिसे उस समय महत्वहीन समझा जाता था। 2001 में, टैम्पा सिटी ने भीड़भाड़ वाले शहर पर निगरानी के लिए चेहरा पहचानने वाले सॉफ्टवेयर का इस्तेमाल किया, क्योंकि 2001 के सुपर बाउल के कारण शहर की सड़कों पर पर्यटकों की बाढ़ आ गई थी। न्यूयॉर्क टाइम्स की एक रिपोर्ट के अनुसार, सॉफ्टवेयर ने 19 लोगों की पहचान की जिनके खिलाफ कथित तौर पर बकाया वारंट थे; हालांकि, कोई गिरफ्तारी नहीं हुई क्योंकि स्टेडियम के बुनियादी ढांचे ने भारी भीड़ के बीच पहचाने गए अपराधियों तक पहुंचना असंभव बना दिया था।

जबकि इस विशेष मामले में नस्लीय प्रोफाइलिंग के संकेत कहीं भी नहीं देखे गए थे, यह पहली बार था जब निगरानी तकनीकों को नागरिक स्वतंत्रता और व्यक्तियों की गोपनीयता के उल्लंघन के खिलाफ रखा गया था। आगामी वर्षों में, टैम्पा पुलिस ने अविश्वसनीय परिणामों का हवाला देते हुए इन निगरानी प्रणालियों को छोड़ दिया।

कुछ और हालिया परिदृश्य के लिए तेजी से अग्रेषण, अली ब्रेलैंड ने ब्रेंटवुड क्षेत्र में एक कुख्यात ड्रग डीलर होने का आरोप लगाते हुए विली लिंच की गिरफ्तारी के बारे में द गार्जियन के लिए सूचना दी, जो मुख्य रूप से रंग के लोगों का पड़ोस था। लिंच के खिलाफ एकमात्र सबूत एक मोबाइल पर उसकी तस्वीरें थीं, जो पुलिस डेटाबेस के खिलाफ चल रही थीं, इससे पहले कि पुलिस ने उसे अपराधी के रूप में निर्धारित किया। लिंच को आठ साल की सजा हुई थी, जिसने अब सजा के खिलाफ अपील की है। वह कथित डीलर था या नहीं, यह अनिवार्य रूप से इस बात पर चिंता पैदा करता है कि क्या केवल मशीन-आधारित परिणाम जांच के तहत किसी की सजा को बनाए रखने के लिए पर्याप्त है?

2019 में, द गार्जियन के लिए टॉम पर्किन्स द्वारा रिपोर्ट की गई, डेट्रायट पुलिस को पिछले दो वर्षों से कथित रूप से गिरफ्तारी करने के लिए चेहरे की पहचान का उपयोग करते हुए पाया गया। डेट्रायट एक ऐसी जगह है जहां की 80% से ज्यादा आबादी अश्वेत है। डेट्रायट पुलिस आयोग के एक काले सदस्य के एक बयान ने अभ्यास के खिलाफ चिंता जताई। उन्होंने कहा कि काले लोगों में एक सामान्य चेहरे का लक्षण होता है जो सिस्टम के एल्गोरिदम को खतरे में डालता है, इसे "तकनीकी-जातिवाद" कहा जाता है।

Fabio Bacchini और Ludovica Lorusso द्वारा जर्नल ऑफ़ इंफॉर्मेशन कम्युनिकेशन एंड एथिक्स सोसाइटी के लिए 2019 के एक शोध में, यह पाया गया कि ये बायोमेट्रिक और फेस रिकग्निशन सिस्टम कानून प्रवर्तन के लिए 100% विश्वसनीय नहीं हैं। इसके अलावा, नस्लीय भेदभाव ऐसी सभी व्यवस्थाओं पर एक नकारात्मक प्रभाव था, जिसके आगे सामाजिक प्रभाव उलटे हैं। अध्ययन ने विशेष रूप से पश्चिमी समाजों को लक्षित किया, जहां निगरानी के लिए ऐसी प्रणालियों का बड़े पैमाने पर उपयोग किया जाता है।

ये ऐसे कई उदाहरणों में से केवल तीन हैं जहां चेहरे की पहचान प्रणाली के कारण होने वाली नस्लीय असमानताओं के मामले प्रकाश में आए हैं। लेकिन तकनीक में एल्गोरिथम कोडिंग अपग्रेड में इतनी बढ़ती सटीकता के बावजूद ये सिस्टम इतने अक्षम क्यों हैं।

पश्चिमी राज्यों में श्वेत वर्चस्व:एक श्वेत-प्रमुख तकनीकी उद्योग

2014 में, विशाल ऐप्पल इंक समेत अधिकांश तकनीकी कंपनियां ज्यादातर सफेद, पुरुष कर्मचारियों को भर्ती करती पाई गईं। Apple में, 55% कर्मचारी श्वेत थे, और इसी तरह, Apple नेतृत्व में 63% श्वेत कर्मचारी शामिल थे। समान विविधता रिपोर्ट साझा करने वाली कंपनियों में फेसबुक, गूगल और ट्विटर भी शामिल हैं। पांच साल बाद, वायर्ड में एक रिपोर्ट ने खुलासा किया कि इन नंबरों में न्यूनतम सुधार हुआ है।

जबकि फेसबुक ने संख्या में एक अच्छा सुधार दिखाया, Apple के काले तकनीकी कर्मचारियों का प्रतिशत कुल कार्यबल के मात्र 6% पर अपरिवर्तित था। अमेज़ॅन एकमात्र संगठन था जिसने 42% काले या लैटिन अमेरिकी श्रमिकों को अपने अमेरिकी कार्यालयों में पंजीकृत किया था।

ये आँकड़े क्या दर्शाते हैं? अमेरिका में, अधिकांश कोडर, जिन्हें प्रमुख परियोजनाओं जैसे कि निगरानी प्रणालियों के लिए एल्गोरिदम डिजाइन करने के लिए सौंपा गया है, सफेद हैं। ये वे लोग हैं जो किसी कंपनी द्वारा लॉन्च/अनावरण किए जाने वाले उत्पाद या सेवा के संबंध में सबसे महत्वपूर्ण निर्णय लेते हैं। और इसलिए, यह उनका दृष्टिकोण, दृष्टिकोण और विचार प्रक्रियाएं हैं जो अंतिम निर्माण में चलती हैं। इसका मतलब यह नहीं है कि गोरे लोग नस्लवादी हैं और उन्होंने जानबूझकर ऐसी निगरानी प्रणाली तैयार की है। नहीं!

जब एक गोरे व्यक्ति ने चेहरे की पहचान करने वाले एल्गोरिदम को डिज़ाइन किया है और उसके पास केवल सफेद सहयोगी हैं जो उससे परामर्श/सहायता कर रहे हैं, तो वे कोड को अंतिम रूप देने से पहले अन्य रंग के चेहरे के लक्षणों पर विचार नहीं करते हैं। चूंकि तकनीकी उद्योग में सफेद इंजीनियरों का दबदबा है, प्रारंभिक कोड तैयार करने के लिए उपयोग किए जाने वाले डेटा संग्रह भी सफेद तकनीशियनों द्वारा बनाए और कैलिब्रेट किए जाते हैं। इस प्रकार, कोड स्वयं अपने मूल गणनात्मक एल्गोरिथम में पूर्वाग्रह के साथ बनाया गया है, जिसके परिणामस्वरूप निगरानी परिणामों में ये नस्लीय असमानताएं हैं।

कोड केवल यह सीखता है कि गोरे लोग इसमें क्या शामिल हैं। दूसरे रंग के किसी व्यक्ति का कोई दृष्टिकोण या योगदान नहीं है।

अंशांकन मुद्दे

अमेरिकी कानून प्रवर्तन निगरानी और डेटा ट्रैकिंग पर बहुत अधिक निर्भर करता है। ऐसे कई उदाहरण हैं जहां मुखबिरों ने नागरिकों की अनधिकृत निगरानी के बारे में जानकारी को हटा दिया। एनएसए की अवैध निगरानी का एडवर्ड स्नोडेन का रहस्योद्घाटन एक ऐसा ही उदाहरण है।

ये निगरानी कार्यक्रम लाखों नागरिकों के चेहरे के निशान और अन्य व्यक्तिगत जानकारी द्वारा समर्थित हैं। यदि हम केवल चेहरे के निशानों पर विचार करें, तो लाखों अमेरिकी खुले तौर पर सोशल मीडिया प्लेटफॉर्म पर तस्वीरें साझा कर रहे हैं। फिर देश की हर गली में सीसीटीवी कैमरे हैं जो सैकड़ों हजारों राहगीरों के लाइव फुटेज पेश करते हैं। वर्तमान में, पुलिस डेटाबेस में लगभग 117 मिलियन इमेज हैं, जबकि FBI के पास सर्विलांस फेस रिकग्निशन एल्गोरिदम में कैलिब्रेट करने के लिए 400 मिलियन से अधिक डेटासेट हैं।

अब कल्पना करें कि इन डेटासेट की तुलना किसी एक छवि से की गई है, जिसमें किसी व्यक्ति विशेष के चेहरे के सभी लक्षण शामिल हो सकते हैं या नहीं भी हो सकते हैं। ऐसे में गड़बड़ी की संभावना बनी रहती है। इसे समझने और इसे एक फ़ेसप्रिंट के विरुद्ध चलाने के लिए बहुत अधिक डेटा है। जब अंशांकन इतना जटिल हो तो कोई भी एल्गोरिथम इसके परिणाम में सौ प्रतिशत आश्वासन की गारंटी नहीं दे सकता है। यह अंततः चेहरे की पहचान तकनीक के कारण नस्लीय प्रोफाइलिंग में जुड़ जाता है।

चेहरे की पहचान पर अत्यधिक विश्वसनीयता

विली लिंच का मामला एक अनुस्मारक है कि जब कानून प्रवर्तन की बात आती है तो चेहरे की पहचान सबूत के रूप में पेश की जाने वाली एकमात्र विश्वसनीय तकनीक नहीं होनी चाहिए। यही कारण है कि टाम्पा सिटी पुलिस ने तकनीक को छोड़ दिया।

यह सच है कि चेहरे की पहचान एक बेहतरीन उपाय है और पुलिस के लिए मददगार है। बोस्टन मैराथन बम धमाकों के दोषियों को निगरानी रिकॉर्डिंग के व्यापक और विस्तृत विश्लेषण का उपयोग करके पहचाना गया। लेकिन यह किसी को दोषी ठहराने का इकलौता सबूत नहीं हो सकता। चेहरे की पहचान एल्गोरिदम के परिणामों को साबित करने के लिए सहायक सबूत होने चाहिए, और अंतिम निर्धारण तक पहुंचने से पहले ऑटोमेशन पूर्वाग्रह की अवधारणा पर विचार किया जाना चाहिए।

हार्डवेयर की समस्या:मोबाइल और कैमरों में चेहरे की पहचान

निगरानी कैमरा सिस्टम और संबंधित हार्डवेयर और सॉफ्टवेयर किसी एक कंपनी द्वारा डिजाइन नहीं किए गए हैं। यह अरबों डॉलर का उद्योग है जिसमें दसियों निगम कानून प्रवर्तन एजेंसियों से अनुबंध प्राप्त करने के लिए प्रतिस्पर्धा करते हैं। इनमें से कई सिस्टम चीनी निर्माताओं के हैं। यह सर्वोत्तम गुणों वाली सबसे सस्ती तकनीक प्राप्त करने के बारे में है। यह ज्यादातर काम करता है। और इसलिए, हमेशा विभिन्न प्रणालियों के अंशांकन में अंतर, साथ ही निगरानी परिणामों की गुणवत्ता में भिन्नता की संभावना होती है। कई कैमरा सर्विलांस एल्गोरिदम सिर्फ तकनीकी अक्षमता के कारण रंग के लोगों की छवियों को कैलिब्रेट करने में अप्रभावी हैं, इस प्रकार नस्लीय भेदभाव को महिमामंडित करते हैं।

फेस रिकग्निशन के जरिए नस्लवाद पैदा करने वाले तकनीकी मुद्दों को भी Apple फेस लॉक फीचर में देखा गया है। चीन से एक मामला सामने आया कि iPhone X फेस लॉक दो अलग-अलग चीनी सहकर्मियों के बीच अंतर करने में असमर्थ था, जिससे यह सुविधा बेकार हो गई। दो काले लोगों को एक दूसरे से अलग करने की सुविधा में मुद्दों का हवाला देते हुए इसी तरह की रिपोर्ट को खारिज कर दिया गया। जैसा कि ऊपर कहा गया है, तकनीकी टीमों में Apple के केवल 6% अश्वेत लोग हैं। यह इस बात का एक स्पष्ट उदाहरण है कि चेहरा पहचानने वाली तकनीक हमारे हाथ में पकड़े जाने वाले उपकरणों में भी नस्लवाद को कैसे बढ़ावा दे सकती है।

निष्कर्ष

हां, फेशियल रिकग्निशन नस्लवादी है, और यह अब सामान्य ज्ञान है। जबकि तकनीक ऐसे मुद्दों को सुधारने के लिए प्रतिदिन बढ़ रही है, परिणाम सभी समान हैं। तकनीकी प्रगति और विकास के सामान्य लक्ष्यों पर प्रौद्योगिकी को दुनिया को एकजुट करना चाहिए, लेकिन कुछ तकनीकें सिर्फ नस्लीय और सांप्रदायिक सद्भाव को नुकसान पहुंचा रही हैं।

अभी के लिए, कानून प्रवर्तन अधिकारी जो सबसे अच्छी बात कर सकते हैं, वह एल्गोरिथम अंशांकन से सबूत के आधार पर उनके मामलों का समर्थन नहीं कर रहा है, जो विश्वसनीय भी नहीं हैं। इसके अलावा, यह सही समय है कि कार्यस्थलों में विविधता और समावेश को गंभीरता से लिया जाए ताकि सभी जातियों के लोग एक साथ आकर एक ऐसा उत्पाद तैयार कर सकें जो नस्लीय असमानताओं से मुक्त हो। दुनिया में हजारों नस्लें हैं, और नस्लीय मतभेदों को दूर करने के लिए लोग बढ़े हैं, जिसने वैश्विक समाज को इतने लंबे समय तक परेशान किया है। अगर इसे बनाए रखना है, तो जिन मशीनों पर हम खुद पर इतना भरोसा करते हैं, उन्हें वही सिखाना होगा।