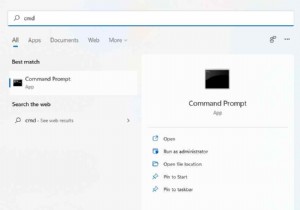

यह पता चला है कि अधिकांश शोधकर्ता उस स्रोत कोड की रिपोर्ट नहीं करते हैं जिसका उपयोग उनके एआई को सिखाने के लिए किया गया था जो अन्य वैज्ञानिकों को परेशान कर रहा है क्योंकि वे केवल परिणामों की नकल नहीं कर सकते हैं और आगे काम कर सकते हैं।

सीधे शब्दों में कहें तो आर्टिफिशियल इंटेलिजेंस का बढ़ता क्षेत्र प्रतिकृति संकट से जूझ रहा है। यह कुछ लोगों को सामान्य लग सकता है, लेकिन एआई के प्रति उत्साही लोगों के लिए यह किसी आपदा से कम नहीं है। लेकिन हमें किए गए शोधों की प्रतिकृति या बैकट्रैकिंग की आवश्यकता क्यों है? अधिक जानने के लिए आगे पढ़ें!

प्रतिकृति क्या है?

एक प्रक्रिया जिसमें एक शोधकर्ता मॉडल/सॉफ्टवेयर/एल्गोरिदम या अनुसंधान की किसी सामग्री को पीछे कर सकता है, प्रतिकृति के रूप में जाना जाता है। एआई का क्षेत्र अपवाद बनता जा रहा है क्योंकि ऐसा करना पेशेवरों के लिए एक कठिन कार्य होता जा रहा है। बिना पीछे हटे हम फंस सकते हैं!

बैकट्रैकिंग इतना महत्वपूर्ण क्यों है?

लोकप्रिय धारणा के विपरीत, प्रतिकृति के अपने फायदे हैं। आप उन्हें सत्यापित करने या प्रतिमान में परिवर्तन प्रस्तावित करने के लिए परिणामों तक आसानी से पहुँच सकते हैं। इसने उन लोगों के लिए अद्भुत काम किया है जो स्वचालन के क्षेत्र में शोध कर रहे थे क्योंकि वे उपयोग की गई मशीनों को आसानी से संशोधित कर सकते थे और उन्हें अच्छे के लिए अपग्रेड कर सकते थे।

इसलिए, यदि आप हमसे पूछें कि क्या एआई पर अध्ययनों को दोहराना संभव है, तो हम कहेंगे, “नहीं आप नहीं कर सकते।”

शोधकर्ता आमतौर पर स्रोत कोड साझा नहीं करते हैं। निकोलस रौगियर के अनुसार, (फ्रांस के नेशनल इंस्टीट्यूट फॉर रिसर्च इन कंप्यूटर साइंस एंड ऑटोमेशन में एक कम्प्यूटेशनल न्यूरोसाइंटिस्ट), क्षेत्र के बाहर के लोग विचार कर सकते हैं कि कुछ सख्त नियम हैं जो वांछित परिणाम दे सकते हैं, लेकिन जो लोग इस पर काम कर रहे हैं वे जानते हैं वास्तविक संघर्ष। हालांकि, हम स्रोत कोड साझा नहीं करने के लिए किसी को दोष देने की स्थिति में नहीं हैं क्योंकि वे किसी कंपनी के कॉपीराइट के अधीन हो सकते हैं या कभी-कभी, शोधकर्ता का लक्ष्य क्षेत्र में किसी भी विकास को प्रस्तुत करना है। लेकिन जब सॉफ्टवेयर या मशीन मशीन लर्निंग एल्गोरिथम द्वारा संचालित होती है तो चीजें काफी जटिल हो जाती हैं। क्योंकि ये मशीनें अनुभवों और अन्य अनुकरणों के माध्यम से सीखती हैं, आपको कभी भी अन्य मशीनों के समान कुछ नहीं मिलेगा। इसलिए, भले ही दुर्लभतम मामले में, आपको स्रोत कोड मिल जाए, आप कभी भी वांछित परिणाम प्राप्त करने में सक्षम नहीं होंगे जब तक कि आपने अपनी मशीन को इसी तरह प्रशिक्षित नहीं किया हो।

यह कमोबेश एक काल्पनिक स्थिति है क्योंकि मशीन को पहले प्रशिक्षित करने के लिए जिस कार्यप्रणाली का इस्तेमाल किया गया था वह आपको कभी नहीं मिलेगा! जब हम यह कहते हैं तो हम पर विश्वास करें, लेकिन किसी के पास हर संभव स्थिति में एल्गोरिदम का परीक्षण करने का समय नहीं है, या दस्तावेज़ में परिभाषित नमूना स्थान नहीं है। यह एक कारण है कि पारंपरिक मशीनों या परियोजनाओं की तुलना में एआई परियोजनाओं को डिजाइन और विकसित करने में अधिक समय लगता है।

इस तथ्य से इनकार नहीं किया जा सकता है कि हमें इस संस्कृति को बदलने की आवश्यकता है क्योंकि इसके बिना तेजी से बढ़ना एक दूर का सपना ही रहेगा!

क्या यह तरीका इष्टतम है?

पेशेवरों का कहना है कि इसे गुप्त या केवल कुछ चुनिंदा लोगों के साथ साझा करने की आवश्यकता है ताकि हमारी सुरक्षा और अस्तित्व दांव पर न लगे! लेकिन हमें कैसे पता चलेगा कि जिनके साथ सोर्स कोड शेयर किया गया है वो इसका गलत इस्तेमाल तो नहीं करने वाले हैं? अगर आप सोच रहे हैं कि आप इसके लिए मशीन लर्निंग एल्गोरिथम डिजाइन कर सकते हैं, तो भी आपको पता होना चाहिए कि यह अभी तक उस मुकाम तक नहीं पहुंचा है। और इसलिए, आप मानव व्यवहार का पता लगाने के लिए एल्गोरिद्म पर भरोसा नहीं कर सकते।

अब क्या किया जाना चाहिए?

हम सोच सकते हैं कि इन अवधारणाओं के बारे में खुले रहने से हो-हल्ला कम होगा, लेकिन इस विश्वास के विपरीत, यह किसी आपदा से कम नहीं होगा। आतंकवादी और कम समझदार दिमाग इंजीनियर को उलट देंगे और सामूहिक विनाश के लिए इसका इस्तेमाल करेंगे। हम केवल यह सिफारिश कर सकते हैं कि जैसे चिकित्सा उद्योग संचालित होता है वैसे ही एल्गोरिदम के परीक्षण के लिए एक बोर्ड का गठन किया जाए। जब तक इसका परीक्षण और अनुमोदन नहीं किया जाता है, तब तक वे दवा की संरचना को जारी नहीं करते हैं। यदि कृत्रिम बुद्धिमान मशीनों के साथ भी ऐसा ही किया जाता है तो चीजें उतनी भयानक नहीं होंगी जितनी कि भविष्यवाणी की गई थी।

हम पहल भी कर सकते हैं और मर्यादा कानूनों की आड़ में छिपने के बजाय मिलकर काम करना फलदायी होगा। अंत में, हमें यह नहीं भूलना चाहिए कि मशीनें पक्षपाती नहीं हैं और अगर "फैसले के दिन" का इंतजार किया जा रहा है, तो हम सभी को खतरा है। एक साथ काम करना और पर्यवेक्षित शिक्षण ही हमारे लिए एकमात्र सहायता बची है।

निष्कर्ष

हम पढ़ाई को दोहरा नहीं सकते, लेकिन मशीनें ऐसा करने में सक्षम हैं। 2017 के अंत में, हमने देखा कि एक एआई ने अपनी तरह का दूसरा निर्माण करने में मदद की। यह AI संचालित मशीन AutoML के नाम से जानी जाने वाली एक परियोजना थी, जिस पर Google काम कर रहा था, और इसलिए इसने AI उद्योग के लिए अगला बड़ा कदम चिह्नित किया। किया गया विकास जश्न मनाने लायक है, लेकिन ऐसा करते हुए हम एक महत्वपूर्ण तथ्य की अनदेखी कर रहे हैं, क्योंकि विकास स्वचालित है, सॉफ्टवेयर मनुष्यों के लिए समझने के लिए कहीं अधिक जटिल होता जा रहा है।

यदि ऐसा ही चलता रहा तो हम वह दिन दूर नहीं जब मानव इनपुट के बिना मशीनें स्वयं का निर्माण कर लेंगी। यह खतरनाक है? हमें ऐसा लगता है! क्या होगा अगर हम बैकट्रैकिंग में व्यस्त हैं और मशीनें अपना क्लोन बनाना शुरू कर देती हैं! दोस्तों अपनी आँखें खुली रखो!

यदि आप अन्यथा सोचते हैं, या इस विषय पर आपके कुछ विचार हैं जो साझा करने योग्य हैं, तो उन्हें नीचे टिप्पणी अनुभाग में बताएं!